Dacă ați observat cumva că jocurile arată din ce în ce mai bine în ultima vreme, mai realistice, mai cinematice, mai cum vreți să le spuneți, puteți da vina în primă fază pe modele și texturi ce sunt scanate direct din lumea reală.

Procesul de fotogrametrie implicat la realizarea lor nu este tocmai simplu sau ieftin, necesitând destul de multă muncă. Dar pe viitor par a fi și soluții ceva mai rapide, judecând după ce au pus la punct recent câțiva cercetători de la Nvidia.

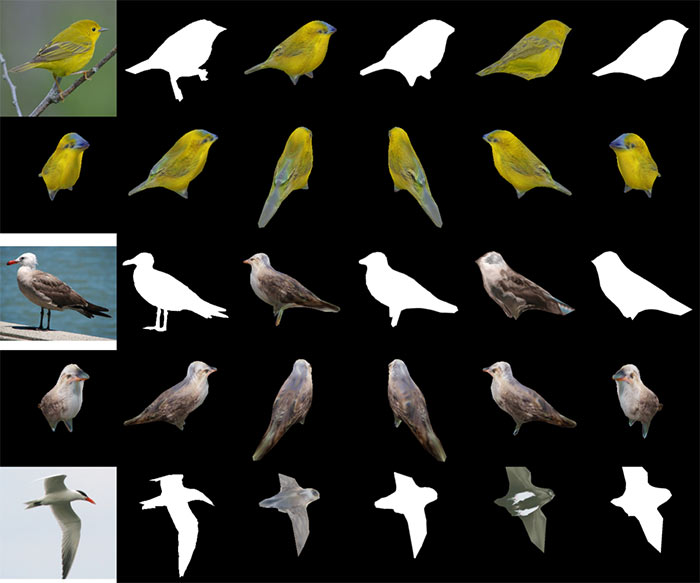

Aceștia au reușit să creeze un sistem de Machine Learning, numit DIB-R, capabil să „înțeleagă” cum ar trebui să arate un obiect 3D bazat doar pe o singură poză 2D a sa. AI-ul este capabil să umple golurile și să transforme o imagine dintr-o singură perspectivă într-un model complet,afișând până și părțile ce nu apăreau în imagine.

Procesul întreg, după ce sistemul a fost antrenat, durează mai puțin de a suta de milioana parte a unei secunde, folosind o placă Nvidia V100 pentru accelerarea calculelor de AI.

Important este că acest sistem nu funcționează doar pe lucruri banale, cum ar fi pietre, dar a fost demonstrat în acțiune și în cazul unor entități mult mai complexe, precum păsări. Ce e drept, nu are rezultate superbe de fiecare dată, după cum puteți vedea în imaginea de mai sus, dar tot este impresionant.

Nvidia tinde să se apuce destul de des de astfel de proiecte, dar nu se materializează în mod direct sub forma vreunui produs efectiv. În cazul de față, DIB-R este inclus în biblioteca de deep learning a PyTorch, un framework pentru astfel de aplicații.

Be First to Comment